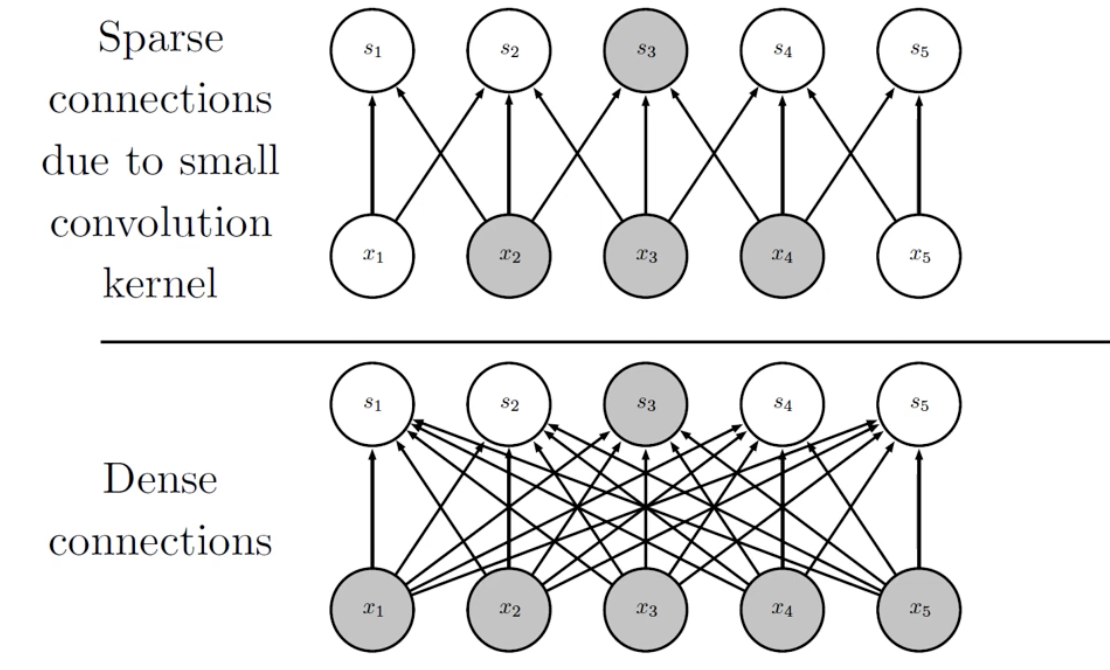

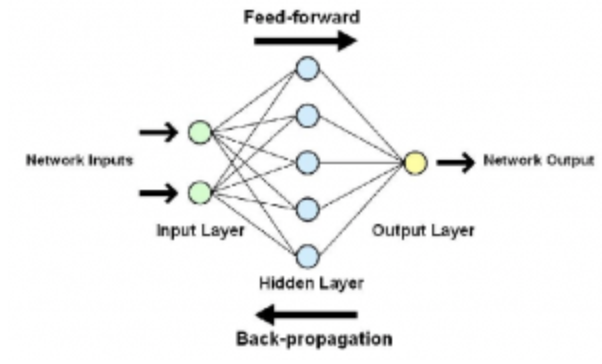

🧑🏻💻용어 정리 Neural Networks Feed-forward Backpropagation Convolutional Neural Network stride filter kernel topology MLP image multi-channel sparse connection parameter sharing AlexNet VGGNet ResNet GoogLeNet LeNet transfer learning 지난 시간에는 Convolutional operation에 대해 다뤘습니다. 오늘은 CNN의 구조에 대해 살펴보겠습니다. CNN Architecture sparse connection sparse connection concept를 봅시다. 위와 같이 dense connections를 우리가 지금까지..