[Deep Learning] - MLP(Multilayer Perceptron)

🧑🏻💻용어 정리

Neural Networks

Nonlinear classification

MLP

Universal approximation theory

오늘은 이전에 배운 Perceptron의 확장된 버전인 MLP와 나아가 MLP의 생성 배경에 대해 알아보고자 한다.

MLP (Multilayer Perceptron)

본 일화의 내용은 사실임이 확인되지 않았씁니다. 재미로 봐주세요.

Perceptron을 만들어낸 Rosenblatt에겐 어릴 적 친구가 있었다고 한다.

Rosenblatt는 항상 일등. 그리고 그 뒤에 만년 2등 친구가 있었다고 한다.

그런데, 여기서 1등인 Rosenblatt이 만들어낸 개념이 Perceptron이다.

원래 생물학에는 존재했지만, 이것을 mathematical하게 정의해서 Computer Science에서 많은 이가 아는 개념이 된 것이다.

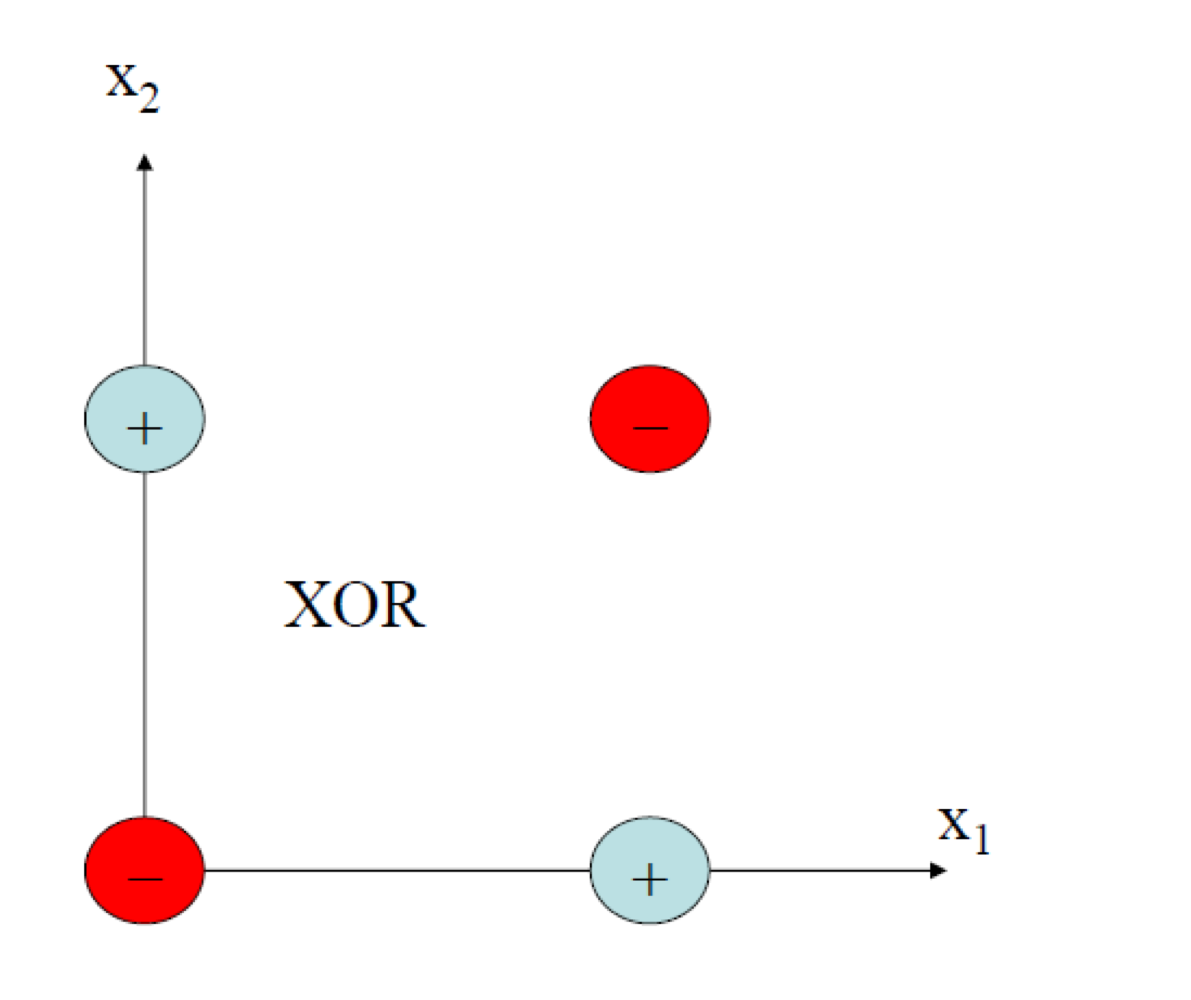

그런데, 2등인 친구가 Simgle layer perceptron으로는 nonlinear한 문제를 해결할 수 없음을 밝혀냈다.

그 예시로 위와 같은 XOR Problem이 있다.

그리하여, 2등인 친구는 MLP를 세상에 알리게 된다.

MLP는 Single-layer perceptron에서 하나의 hidden layer를 input과 output 사이에 놓고 한 번 더 학습 과정을 거친다.

그리하여 우리는 이것으로 XOR problem, 즉, nonlinear problem을 해결할 수 있게 되었다.

Combination of multiple linear classifiers

Universal approximation theory

그리고 우리는 MLP에서 hidden node를 엄청나게 많이 만들면, 거의 무한대로 만들면 우리가 가지고 있는 모든 linear, nonlinear problem을 해결할 수 있다고 하였다.

즉 다시 말하면,

3-layer MLP로 세상 모든 문제를 풀 수 있다.

왜곡된 공간들을 한 데 잡아 모으면 Gausian distribution 과 같은 것이 나와 임의의 모양으로 어떠한 class boundary도 만들어 낼 수 있다는 것이다.

'Artificial Intelligence > Deep Learning' 카테고리의 다른 글

| [Deep Learning] Backpropagation (0) | 2023.03.30 |

|---|---|

| [Deep Learning] Feedforward (0) | 2023.03.27 |

| [Deep Learning] - Neural Networks (0) | 2023.03.26 |

| [Supervised Learning] 지도 학습 (0) | 2023.02.08 |

| [Machine Learning] 신경망 기초 3 (0) | 2023.02.08 |